테슬라가 오늘 로보택시 차량의 사이버 캡을 공개했습니다. 하지만 기대했던 것과 달리 여론은 다소 실망스러운 모습입니다. 대당 약 4천만원 수준으로 책정했고, 26년에 선보여 27년부터 대량생산을 하겠다고 밝혔습니다. 하지만 과연 2027년에도 대량 양산이 이뤄질까? 라는 의문이 있고, 이와 관련된 법규도 함께 따라야 실제 매출이 대폭 증가한다고 보기 때문에 다소 보수적으로 언론은 판단하고 있는 것 같습니다. 테슬라가 오늘 로보택시 차량의 사이버 캡을 공개했습니다. 하지만 기대했던 것과 달리 여론은 다소 실망스러운 모습입니다. 대당 약 4천만원 수준으로 책정했고, 26년에 선보여 27년부터 대량생산을 하겠다고 밝혔습니다. 하지만 과연 2027년에도 대량 양산이 이뤄질까? 라는 의문이 있고, 이와 관련된 법규도 함께 따라야 실제 매출이 대폭 증가한다고 보기 때문에 다소 보수적으로 언론은 판단하고 있는 것 같습니다.

“페달-핸들 필요 없어”···테슬라, 자율주행 로보택시 ‘사이버캡’ 공개 테슬라가 운전자와 페달 없이 완전 자율주행 기술로 운행되는 무인(로보)택시를 최초로 공개했다. 2026년 약 3만달러(약 4000만원) 미만으로 출시할 계획이다. 일론 머스크····www.donga.com “페달-핸들 필요 없어”···테슬라, 자율주행 로보택시 ‘사이버캡’ 공개 테슬라가 운전자와 페달 없이 완전 자율주행 기술로 운행되는 무인(로보)택시를 최초로 공개했다. 2026년 약 3만달러(약 4000만원) 미만으로 출시할 계획이다. 일론 머스크… www.donga.com

이처럼 자동차 산업에서는 자율주행(AD) 자동차, 특히 로보택시에 많은 관심이 쏠리고 있습니다. 이러한 로보택시에 활용되는 자율주행차 기술은 도대체 어떻게 개발되고 구현될까요? 관련해서 기술에 대해서 조금씩 알아보려고 합니다. 1. 자율주행(AD) 단계별 구현/수준 이처럼 자동차 산업에서는 자율주행(AD) 자동차, 특히 로보택시에 많은 관심이 쏠리고 있습니다. 이러한 로보택시에 활용되는 자율주행차 기술은 도대체 어떻게 개발되고 구현될까요? 관련해서 기술에 대해서 조금씩 알아보려고 합니다. 1. 자율주행(AD) 단계별 구현/레벨

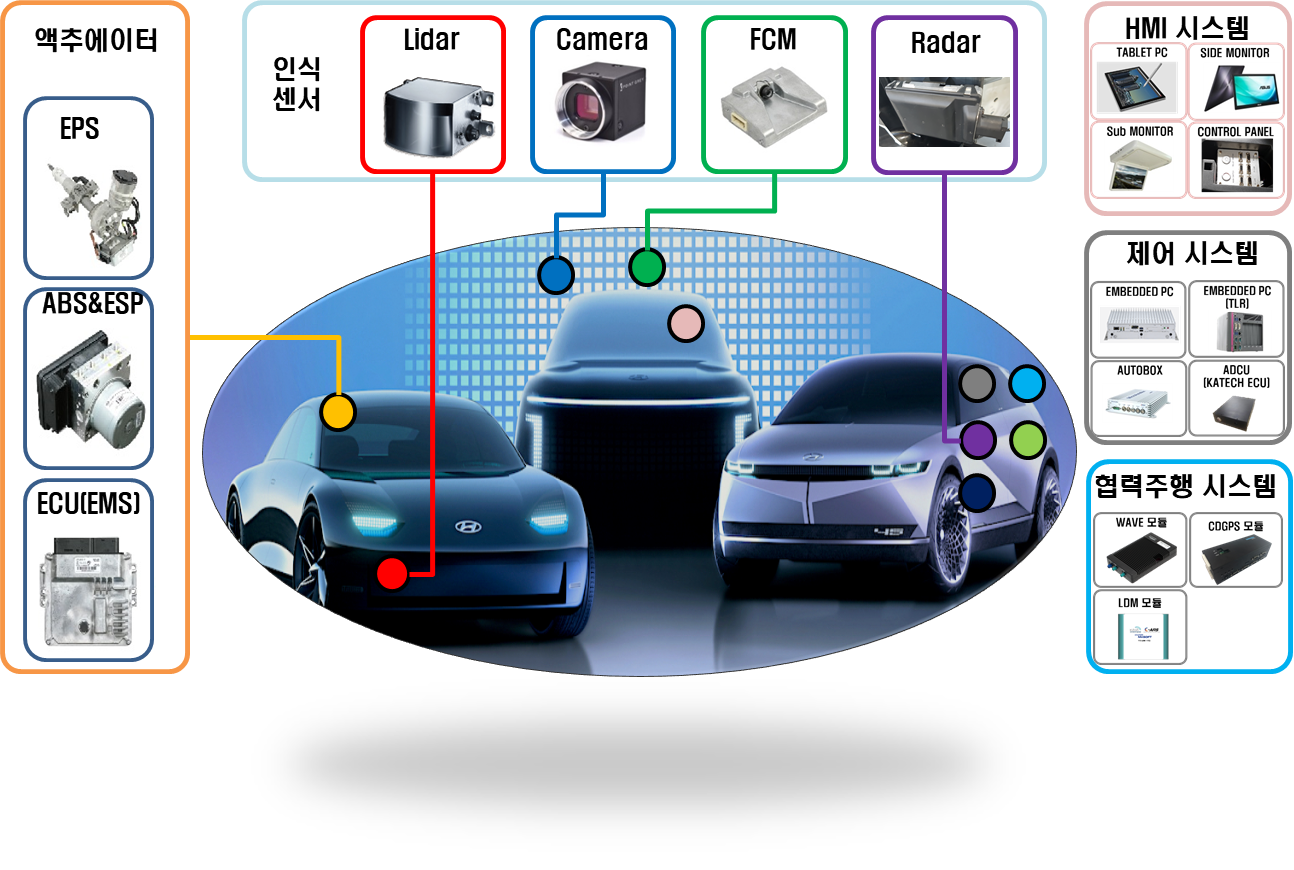

출처: 현대트렌시스 출처: 현대트렌시스

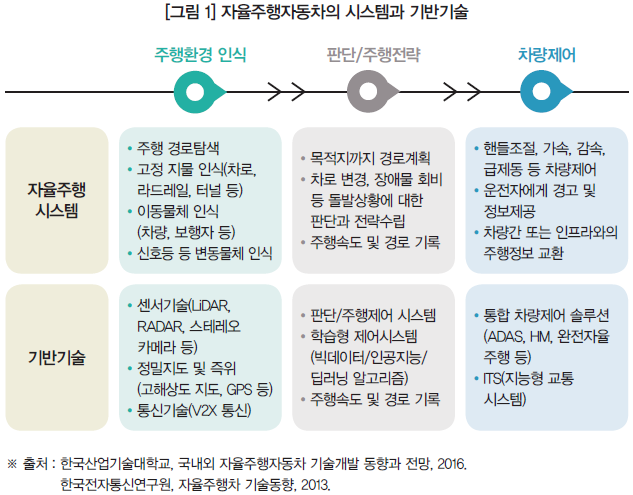

자율주행자동차 기술은 SAE라는 국제자동차기술자협회로 Level 0부터 Level 5까지 총 6단계로 나눠져 있습니다. 기술의 발전 정도에 따라서 이렇게 단계가 구분이 된 거죠. Level 1은 운전자가 운전하는 것을 돕는 정도입니다. 예를 들어, 차간 거리를 유지하거나 차선을 유지하는 기능 같은 것입니다. Level 2는 특정 상황에서 차량이 직접 운전하는 것을 제어할 수 있습니다, 하지만 여전히 운전자가 즉시 개입할 준비를 하고 있어야 합니다. 만약 사고가 나면 운전자가 책임을 져야 하거든요. Level3부터 본격적인 기술이라고 할 수 있습니다. Level 3에서는 고속도로처럼 도로 상태가 좋은 곳에서 AD 시스템이 차를 운전합니다. 운전자는 필요할 때만 개입하면 돼요. 중요한 것은 여기서부터는 운전 주체가 사람에서 AD 시스템으로 넘어갑니다. 그래서 사고가 나면 운전자가 아닌 AD 시스템을 만든 회사가 책임을 지게 됩니다. 그래서 이 단계부터는 안전성이 정말 중요해집니다. Level 4는 대부분의 상황에서 차량이 스스로 운전할 수 있지만 특정 제한된 상황에서는 사람이 개입해야 할 수도 있습니다. 운전자가 주행 중에 개입할 필요가 거의 없습니다. 그리고 Level 5는 완전 자율주행입니다. 이 단계에서는 차량이 모든 상황에서 완벽하게 스스로 운전할 수 있기 때문에 핸들이나 페달 등도 필요 없을 정도입니다. 현재 가장 앞선 AD 기술을 보유하고 있는 것은 구글의 웨이모인데, 이 회사는 레벨 4 기술을 가지고 있습니다. 자동차 업체 중에서는 벤츠가 북미에서 Level 3 AD 시스템을 제공하고 있습니다. 테슬라의 **FSD(Full Self Driving)**는 공식적으로는 Level 2로 분류되지만 기술적으로는 Level 3에 가까운 성능을 보이고 있습니다. AD 시스템은 크게 3가지 단계로 구성되어 있습니다. 그것은 인식(Perception), 판단(Decision), 그리고 제어(Control)입니다. 자율주행자동차 기술은 SAE라는 국제자동차기술자협회로 Level 0부터 Level 5까지 총 6단계로 나눠져 있습니다. 기술의 발전 정도에 따라서 이렇게 단계가 구분이 된 거죠. Level 1은 운전자가 운전하는 것을 돕는 정도입니다. 예를 들어, 차간 거리를 유지하거나 차선을 유지하는 기능 같은 것입니다. Level 2는 특정 상황에서 차량이 직접 운전하는 것을 제어할 수 있습니다, 하지만 여전히 운전자가 즉시 개입할 준비를 하고 있어야 합니다. 만약 사고가 나면 운전자가 책임을 져야 하거든요. Level3부터 본격적인 기술이라고 할 수 있습니다. Level 3에서는 고속도로처럼 도로 상태가 좋은 곳에서 AD 시스템이 차를 운전합니다. 운전자는 필요할 때만 개입하면 돼요. 중요한 것은 여기서부터는 운전 주체가 사람에서 AD 시스템으로 넘어갑니다. 그래서 사고가 나면 운전자가 아닌 AD 시스템을 만든 회사가 책임을 지게 됩니다. 그래서 이 단계부터는 안전성이 정말 중요해집니다. Level 4는 대부분의 상황에서 차량이 스스로 운전할 수 있지만 특정 제한된 상황에서는 사람이 개입해야 할 수도 있습니다. 운전자가 주행 중에 개입할 필요가 거의 없습니다. 그리고 Level 5는 완전 자율주행입니다. 이 단계에서는 차량이 모든 상황에서 완벽하게 스스로 운전할 수 있기 때문에 핸들이나 페달 등도 필요 없을 정도입니다. 현재 가장 앞선 AD 기술을 보유하고 있는 것은 구글의 웨이모인데, 이 회사는 레벨 4 기술을 가지고 있습니다. 자동차 업체 중에서는 벤츠가 북미에서 Level 3 AD 시스템을 제공하고 있습니다. 테슬라의 **FSD(Full Self Driving)**는 공식적으로는 Level 2로 분류되지만 기술적으로는 Level 3에 가까운 성능을 보이고 있습니다. AD 시스템은 크게 3가지 단계로 구성되어 있습니다. 그것은 인식(Perception), 판단(Decision), 그리고 제어(Control)입니다.

출처: 현대 H-Mobility 출처: 현대 H-Mobility

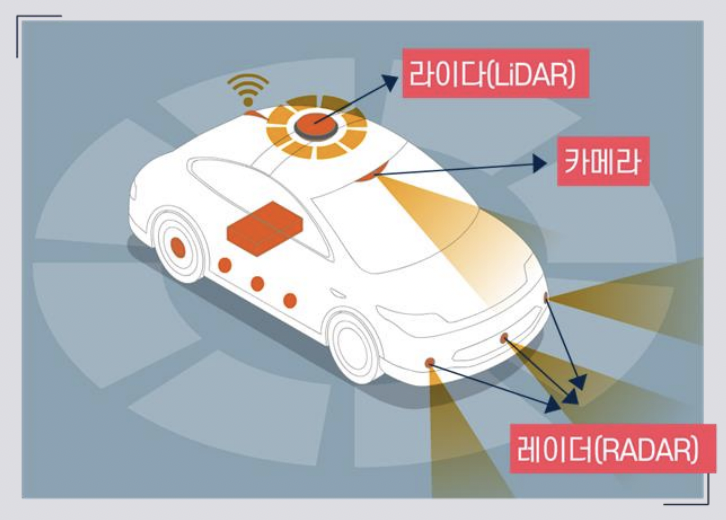

1. 인식 단계 차 안에 있는 센서나 GPS를 사용해 차 주변에 있는 물체나 상황을 먼저 파악합니다. 센서는 카메라, 레이더, LiDAR 같은 장치를 말하는데, 이 센서들이 자동차 주위에서 일어나고 있는 것을 인식합니다. 마치차의눈과귀역할을하는것이죠. 오늘 1편에서는 이 인식 단계에 대해서 알아보겠습니다. 2. 판단 단계에서 인식한 정보를 바탕으로 차량이 어떻게 움직여야 하는지 판단합니다. 이때 차가 어디로 가야 하는지, 속도는 얼마나 낼지, 멈춰야 하는 상황인지 등을 결정하는 거죠. 이 부분은 자동차의 뇌라고 할 수 있는 반도체 칩이 담당하고 있습니다. 예를 들어 테슬라의 HW4.0, 모빌아이의 아이큐, 그리고 엔비디아의 올린칩 등이 그 역할을 합니다. 그리고 최근에는 AI 기술도 많이 활용되고 있습니다. AI가 더 지혜롭게 차가 무엇을 해야 할지 결정하도록 돕고 있는 것입니다. 3. 제어 단계의 마지막에 판단이 끝나면 차량이 실제로 움직이도록 제어하는 단계입니다. 정해진 조향(핸들 돌리기), 속도 조절, 제동(브레이크 밟기)과 같은 동작을 ECU(전자제어장치)가 명령해 차가 움직이도록 하는 겁니다. 그래서 우리가 자율주행 자동차 기술이 실제로 작동하는 모습을 볼 수 있게 되는 것입니다. 오늘은 AD 시스템이 센서로 수집한 정보를 어떻게 처리하는지에 대해서 집중해보도록 하겠습니다. 센서는 도로 위에 있는 장애물이나 도로 상태를 이미지나 영상 데이터로 수집합니다. 그리고 이 Raw 데이터를 분석하고 처리하는데 이 과정이 끝나면 차량 주변 장애물의 위치를 정확히 인식할 수 있게 됩니다. 또한 이 정보는 V2X(Vehicle to Everything)나 GPS와 같은 통신 기술을 통해 다른 차량이나 인프라, 심지어 보행자와도 교환됩니다. 이렇게 하면 보다 정확한 위치 데이터를 확보할 수 있습니다. 해당 정보가 전달되면 AD 시스템이 차량과 주변 환경을 정확히 파악하게 되고, 이후 주행에 대한 판단을 합니다. 그리고 마지막으로 그 판단에 따라 자동차가 실제로 움직이도록 제어하는 것입니다. 센서 이외의 나머지 기술에 대해서는 다음 편에서 조금씩 자세히 설명하겠습니다. 2. 업계 전반의 Player? 1. 인식 단계 차 안에 있는 센서나 GPS를 사용해 차 주변에 있는 물체나 상황을 먼저 파악합니다. 센서는 카메라, 레이더, LiDAR 같은 장치를 말하는데, 이 센서들이 자동차 주위에서 일어나고 있는 것을 인식합니다. 마치차의눈과귀역할을하는것이죠. 오늘 1편에서는 이 인식 단계에 대해서 알아보겠습니다. 2. 판단 단계에서 인식한 정보를 바탕으로 차량이 어떻게 움직여야 하는지 판단합니다. 이때 차가 어디로 가야 하는지, 속도는 얼마나 낼지, 멈춰야 하는 상황인지 등을 결정하는 거죠. 이 부분은 자동차의 뇌라고 할 수 있는 반도체 칩이 담당하고 있습니다. 예를 들어 테슬라의 HW4.0, 모빌아이의 아이큐, 그리고 엔비디아의 올린칩 등이 그 역할을 합니다. 그리고 최근에는 AI 기술도 많이 활용되고 있습니다. AI가 더 지혜롭게 차가 무엇을 해야 할지 결정하도록 돕고 있는 것입니다. 3. 제어 단계의 마지막에 판단이 끝나면 차량이 실제로 움직이도록 제어하는 단계입니다. 정해진 조향(핸들 돌리기), 속도 조절, 제동(브레이크 밟기)과 같은 동작을 ECU(전자제어장치)가 명령해 차가 움직이도록 하는 겁니다. 그래서 우리가 자율주행 자동차 기술이 실제로 작동하는 모습을 볼 수 있게 되는 것입니다. 오늘은 AD 시스템이 센서로 수집한 정보를 어떻게 처리하는지에 대해서 집중해보도록 하겠습니다. 센서는 도로 위에 있는 장애물이나 도로 상태를 이미지나 영상 데이터로 수집합니다. 그리고 이 Raw 데이터를 분석하고 처리하는데 이 과정이 끝나면 차량 주변 장애물의 위치를 정확히 인식할 수 있게 됩니다. 또한 이 정보는 V2X(Vehicle to Everything)나 GPS와 같은 통신 기술을 통해 다른 차량이나 인프라, 심지어 보행자와도 교환됩니다. 이렇게 하면 보다 정확한 위치 데이터를 확보할 수 있습니다. 해당 정보가 전달되면 AD 시스템이 차량과 주변 환경을 정확히 파악하게 되고, 이후 주행에 대한 판단을 합니다. 그리고 마지막으로 그 판단에 따라 자동차가 실제로 움직이도록 제어하는 것입니다. 센서 이외의 나머지 기술에 대해서는 다음 편에서 조금씩 자세히 설명하겠습니다. 2. 업계 전반의 Player?

출처 : Renesas 출처 : Renesas

출처: Mentor Graphics 출처: Mentor Graphics

We will take a closer look at how cars with self-driving car technology recognize their surroundings, and this time we will take a closer look at the “recognition” area. There are various sensors used in AD. Examples include cameras, radar, LiDAR, and ultrasonic sensors. The advantages and disadvantages of each are different, and the usage is slightly different. We will take a closer look at how cars with self-driving car technology recognize their surroundings, and this time we will take a closer look at the “recognition” area. There are various sensors used in AD. Examples include cameras, radar, LiDAR, and ultrasonic sensors. The advantages and disadvantages of each are different, and the usage is slightly different.

The camera acts like a human eye to see objects. Cameras have strengths in recognizing the shape and color of objects so that people can distinguish objects with their eyes. Therefore, it plays an important role in distinguishing objects such as cars, people, and bicycles by reading road lanes and signs. And the price is cheaper than other sensors. That doesn’t mean you just need a camera. Cameras may experience poor performance when the weather is bad, such as rain or snow. That’s why other sensors are used together to complement these parts. For more analysis and content, you can subscribe to Naver Premium Content below for KRW 3,900/month, and if you are an office worker, you can subscribe with an additional discount if you send an email to your company, and we will send you related information easily before going to work and during lunch break. The camera acts like a human eye to see objects. Cameras have strengths in recognizing the shape and color of objects so that people can distinguish objects with their eyes. Therefore, it plays an important role in distinguishing objects such as cars, people, and bicycles by reading road lanes and signs. And the price is cheaper than other sensors. That doesn’t mean you just need a camera. Cameras may experience poor performance when the weather is bad, such as rain or snow. That’s why other sensors are used together to complement these parts. For more analysis and content, you can subscribe to Naver Premium Content below for KRW 3,900/month, and if you are an office worker, you can subscribe with an additional discount if you send an email to your company, and we will send you related information easily before going to work and during lunch break.

The first part to explore new technologies for self-driving – Self-driving Eye Sensor Tesla unveiled its self-driving taxi vehicle, CyberCap, today. However, public opinion seems to be somewhat disappointed, contrary to expectations. It was set at about 40 million won per unit and announced that it will be introduced in 26 years and mass production will begin in 2017. But will mass production take place in 2017? 라는contents.premium.naver.com The first part to explore new autonomous driving technologies – Self-driving eyes, Sensor Tesla, unveiled its self-driving taxi vehicle, CyberCap, today. However, public opinion seems to be somewhat disappointed, contrary to expectations. It was set at about 40 million won per unit and announced that it will be introduced in 26 years and mass production will begin in 2017. But will mass production take place in 2017? 라는contents.premium.naver.com